La regulació europea sobre IA: oportunitats, riscos i escenaris de futur amb mirada metropolitana

Aquest document recull les conclusions del seminari «La regulació europea sobre IA: oportunitats, riscos i escenaris de futur amb mirada metropolitana», celebrat el 19 de setembre de 2024 a la seu de CIDOB, amb acadèmics i experts en matèria de regulació i governança de les tecnologies d’intel·ligència artificial, tant del sector públic com privat. Aquest seminari s’emmarca dins el programa de recerca i prospectiva en geopolítica i relacions internacionals de CIDOB, amb el suport de l’Àrea Metropolitana de Barcelona (AMB). El programa té com a objectiu aportar coneixement al públic general i especialitzat, generar publicacions i debats, així com incorporar noves metodologies de prospectiva a l’anàlisi dels principals reptes internacionals actuals.

La innovació social i tecnològica és crucial per respondre a les necessitats de les persones i avançar cap a governs locals més inclusius i equitatius. Tecnologies disruptives com la intel·ligència artificial (IA) obren noves oportunitats per millorar la prestació de serveis públics i la gestió d’alguns dels reptes urbans més urgents: la mobilitat sostenible, la transició energètica, l’ús responsable de l’aigua, o la reducció de la contaminació, entre d’altres. En els propers anys, l’adopció creixent de la IA comportarà una transformació de les administracions públiques, que han d’estar preparades per encarar els nous desafiaments i els riscos associats amb l’ús extensiu de sistemes algorísmics. Cal tenir en compte, a més, la doble responsabilitat dels governs locals en tant que «consumidors» de solucions tecnològiques, i «reguladors» que han de garantir el marc adequat per al desenvolupament d’una IA ètica, segura, que respecti la legalitat vigent, que sigui compatible amb les nostres normes socials i culturals, i que posi les persones al centre.

En aquest sentit, el Pla d’Actuació Municipal (PAM) 2024-2027 de l’AMB identifica la IA com un dels principals focus de les polítiques metropolitanes del futur. Així, les ciutats metropolitanes han d’estar preparades per adoptar solucions basades en algoritmes i gestionar els riscos que se’n puguin derivar, però també han d’impulsar mesures polítiques que els permetin competir, atraure talent i fidelitzar-lo, per tal d’avançar en la consolidació de l’AMB com a metròpolis digital. I tot això ho han de dur a terme tenint en compte l’entorn normatiu on operen, que en un futur vindrà condicionat pel Reglament europeu d’intel·ligència artificial (conegut com a AI Act), aprovat recentment, però també les tendències geopolítiques a escala global.

Aquest CIDOB Briefing busca contribuir a la reflexió sobre com s’haurien de preparar els governs locals per encarar amb èxit els reptes associats a l’adopció de la intel·ligència artificial. A la primera part, s’analitzaran les implicacions de la regulació europea de la IA per als governs locals i les àrees metropolitanes; mentre que, a la segona, es presentaran els resultats de l’exercici de prospectiva dut a terme en el marc del seminari, on es van identificar alguns futurs desitjats per a la governança de la intel·ligència artificial, les principals incerteses que aquests poden condicionar, i quatre escenaris de futur. L’article conclou amb unes reflexions sobre com es podria garantir que les estratègies i els marcs polítics establerts avui per l’AMB siguin resilients i adaptatius davant les diferents direccions potencials que podrien prendre els processos de transformació digital a escala local.

El context: la regulació europea de la IA i el seu impacte en els governs locals

Després d’anys de negociacions, el 13 de juny de 2024, la Unió Europea (UE) va aprovar el Reglament europeu d’intel·ligència artificial (AI Act), que estableix unes normes en la matèria harmonitzades a escala europea. La característica principal d’aquesta normativa és que pretén establir una regulació integral de la IA a tot el territori europeu, amb l’objectiu de garantir que els sistemes d’IA es desenvolupin i s’utilitzin d’una manera responsable. Per fer-ho, adopta un enfocament basat en riscos: es prohibeixen aquells usos que generen un risc inacceptable perquè són susceptibles de violar drets fonamentals (com alguns sistemes de categorització biomètrica, sistemes de manipulació cognitiva conductual, o sistemes de puntuació social), i es regulen aquells altres que comporten un risc elevat (com les infraestructures crítiques de transport) o limitat (com els assistents de veu). Pel que fa als models d’IA d’ús general, com ara ChatGPT, el reglament té en compte els riscos sistèmics que es podrien derivar del seu ús massiu.

Aquest reglament europeu genera noves obligacions per a un ampli ventall d’actors, des d’empreses i desenvolupadors de tecnologia, fins a governs i entitats reguladores, incloent-hi les administracions locals. En concret, a partir d’ara, els ajuntaments s’hauran de preocupar de classificar correctament els sistemes d’IA que utilitzin o que tinguin intenció d’utilitzar, així com d’identificar els riscos que es puguin derivar del seu ús. Així mateix, a l’hora de licitar l’adquisició d’aquesta tecnologia, caldrà que s’assegurin que els sistemes obtinguts siguin conformes a aquesta i altres normatives europees, com el Reglament general de protecció de dades (Almonacid, 2024)3. Cal tenir present, a més, que molts dels sistemes algorísmics utilitzats pels governs locals podrien ser classificats com d’alt risc o de risc limitat (Galceran-Vercher i Vidal, 2024). En són un exemple els sistemes utilitzats en la provisió de béns i serveis públics essencials, els que s’usen per avaluar l’elegibilitat per a determinades ajudes socials, o aquells que es fan servir per millorar la gestió del trànsit i la mobilitat urbana.

D’altra banda, l’AI Act (art. 27) exigeix que, amb caràcter previ al seu desplegament, els sistemes d’intel·ligència artificial d’alt risc siguin sotmesos a una avaluació sobre l’impacte que el seu ús pot suposar per als drets fonamentals. Això implica que les administracions locals hauran d’implantar auditories sobre algunes aplicacions, idealment de manera recurrent, que tinguin per objectiu avaluar no només els algoritmes sinó també els conjunts de dades per detectar possibles biaixos de gènere, llengua, origen, ètnia, creences, edat, nivell d’educació, discapacitats físiques, psíquiques, de salut o situació econòmica. Finalment, la normativa europea imposa algunes obligacions referents a la transparència i l’explicabilitat dels sistemes algorísmics utilitzats, especialment quan afecten els drets dels ciutadans. Eines molt útils en aquest sentit, i que governs locals com els d’Amsterdam, Hèlsinki, Nantes o Lió ja estan implementant, són els registres públics d’algorismes.

En definitiva, el Reglament europeu d’intel·ligència artificial suposa un desafiament significatiu per als governs locals, que hauran d’adaptar els seus processos, polítiques i estratègies per complir amb les noves exigències. En aquest sentit, una preocupació habitual és si podran implementar aquest nou marc normatiu, no per falta de voluntat sinó de capacitat tècnica. De fet, una problemàtica generalitzada a moltes administracions locals és la falta d’habilitats tècniques i coneixement especialitzat, no només en relació amb l’entramat complex de normatives europees, sinó sobre el funcionament mateix dels sistemes basats en IA2. Així, doncs, existeix la necessitat imperiosa de fomentar l’alfabetització —digital i específica en matèria d'IA—, tant entre els empleats públics, com entre la ciutadania. Només així es podrà aprofitar tot el potencial de la intel·ligència artificial de manera responsable.

Com podem preparar les administracions locals per al dia de demà? Identificació d’incerteses i escenaris plausibles

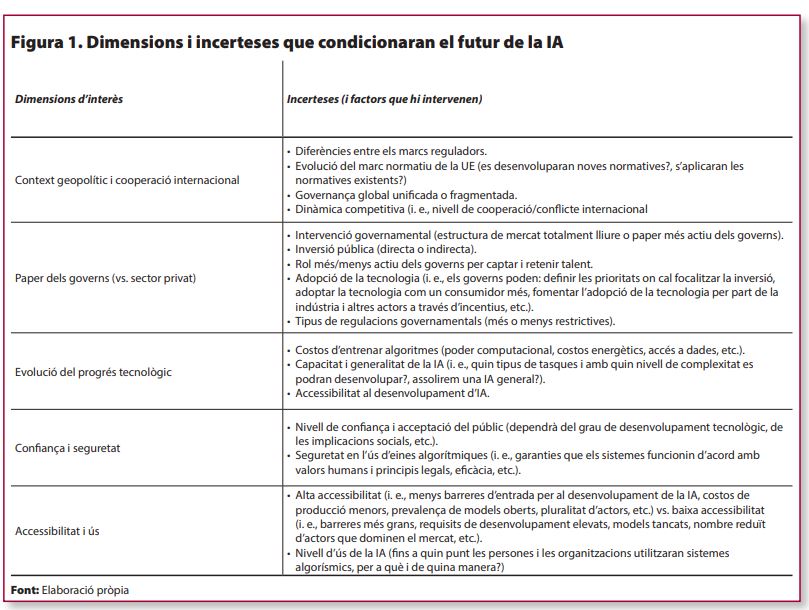

La intel·ligència artificial és una tecnologia de propòsit general, característica que, juntament amb el fet que disposa d’un nombre molt elevat d’aplicacions, genera moltes incerteses i dificulta qualsevol exercici de prospectiva. Aquestes incerteses no només provenen del desenvolupament de la tecnologia en si, sinó també de l’evolució del context polític i socioeconòmic en què s’inscriu el seu ús. Identificar-les, així com estimar l’impacte potencial de la seva evolució sobre els governs locals, ens pot permetre anticipar riscos i oportunitats per millorar la planificació estratègica i l’elaboració de polítiques públiques. A continuació, es presenten cinc dimensions d’interès, així com les incerteses que se’n poden derivar i que poden tenir un major impacte a curt-mitjà termini sobre el desplegament i la governança de sistemes algorísmics a escala local.

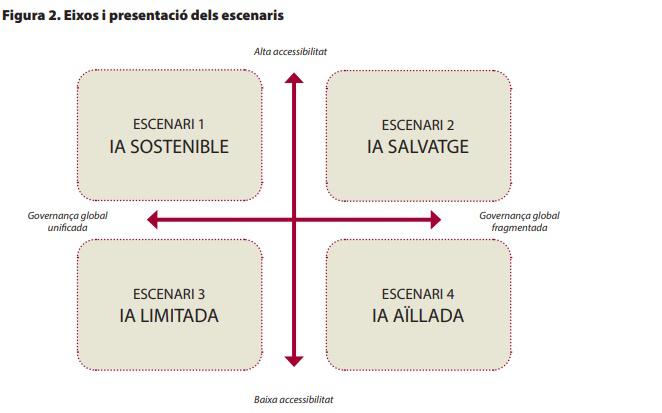

Tenint en compte aquests elements, i a partir de la revisió de diferents exercicis de prospectiva duts a terme durant els darrers quatre anys (específicament: PWC, 2020; United Kingdom Government Office for Science, 2023; Economist Impact, 2024; OECD, 2024), s’han seleccionat dos eixos (l’accessibilitat i el context geopolític) que articulen la construcció d’alguns escenaris plausibles sobre la governança de la intel·ligència artificial durant la pròxima dècada.

Escenari 1 – IA Sostenible

Existeix un consens global tant a l’entorn d’un seguit de principis ètics com d’estàndards tècnics per al desenvolupament de la intel·ligència artificial. La UE ha jugat un paper influent en la negociació d’aquest marc de governança global unificat, que ha acabat incorporant valors com la privadesa, la transparència i la protecció de drets fonamentals bàsics. La majoria de governs del món han adoptat un rol molt actiu: proliferen les estratègies nacionals d’IA, han augmentat significativament els nivells d’inversió pública, i es multipliquen arreu les iniciatives per promoure un ús responsable dels sistemes algorísmics. L’existència de marcs reguladors sòlids i, fins a cert punt, restrictius, ha comportat que es desenvolupin menys aplicacions d’IA, però que les que surten al mercat siguin més segures. Al mateix temps, això ha millorat la percepció pública que els sistemes algorísmics són segurs, i aquests majors nivells de confiança s’han traduït en unes altes taxes de demanda i d’adopció d’aquestes tecnologies. Per últim, aquest escenari es produeix en un context d’alta accessibilitat a la creació i a l’ús de sistemes algorísmics, que s’explica per la preferència dins l’ecosistema de desenvolupadors (i de la indústria) per models de codi obert.

Escenari 2 – IA Salvatge

Han fracassat tots els intents de la darrera dècada per cercar un consens global sobre principis ètics bàsics o estàndards d’harmonització tècnica per al desenvolupament de sistemes d’IA. Per tant, aquest és un món on conviuen múltiples marcs polítics heterogenis, amb diferents nivells de maduresa i que comporten diferents graus de responsabilitat i d’obligacions. Així mateix, s’han format diversos blocs reguladors d’IA entre països amb valors compartits. Un nombre reduït de països s’ha dotat de regulacions i estratègies nacionals d’IA, i hi ha certa inversió pública, però el rol dels governs nacionals en el desenvolupament de sistemes algorísmics és molt modest, i són la indústria i les grans corporacions tecnològiques les que estan protagonitzant el desenvolupament i la regulació d’aquesta tecnologia disruptiva. A més, en aquest escenari, les regulacions que es promouen des dels diferents nivells de govern són molt menys estrictes: en alguns casos fins i tot es flexibilitza la interpretació de les lleis de privacitat de dades per tal de facilitar la innovació i l’experimentació. La fragmentació normativa permet que les empreses i les startups més petites explotin nínxols de mercat, i existeix certa prevalença dels models de codi obert. Aquest entorn d’alta accessibilitat a la tecnologia sense un marc polític unificat, i un enfocament regulador poc estricte, comporten una proliferació incontrolada de sistemes d’intel·ligència artificial per executar pràctiques moralment qüestionables com ara la manipulació de comportament. Així mateix, als actors maliciosos els resulta molt fàcil accedir a sistemes d’IA molt potents, fet que augmenta el risc d’accidents, de ciberatacs, i de proliferació de crisis de deepfakes. Aquesta sensació d’inseguretat i de descontrol fa baixar els nivells de confiança i seguretat en els sistemes algorísmics, i això es tradueix en un ús moderat per part d’organitzacions i de la població en general.

Escenari 3 – IA Limitada

Existeix un cert consens global per a l’establiment d’estàndards tècnics també globals per al desenvolupament de tecnologies d’IA, però no de principis ètics. Hem de parlar, per tant, d’un marc de governança internacional moderadament unificat. En aquest context, la UE té una influència global molt limitada, i són la Xina i els Estats Units els que dominen el mercat mundial. Existeixen algunes regulacions nacionals, però la majoria són molt laxes. Els nivells d’inversió pública en el desenvolupament de sistemes d’IA són molt baixos, i aquest és liderat, en essència, per la indústria. Hi prevalen els models de codi tancat, i la participació d’empreses petites i mitjanes en el mercat és molt limitada. Això s’explica, sobretot, pels alts costos associats amb el desenvolupament de sistemes algorísmics, com també per les dificultats de complir amb marcs reguladors fragmentats (només les grans multinacionals s’ho poden permetre), i la falta d’inversió pública. En aquest escenari, el grau de confiança i d’acceptació pública de l’ús de sistemes algorísmics és molt moderat, fet que comporta uns nivells d’adopció relativament baixos per part d’organitzacions i d’individus.

Escenari 4 – IA Aïllada

No s’ha aconseguit assolir un consens per promoure un marc de governança global unificat de la IA, i, per tant, existeix un mosaic fragmentat d’iniciatives i models reguladors. Aquesta situació també es produeix a la UE, on no s’ha aconseguit implementar de manera satisfactòria la regulació europea d’intel·ligència artificial (EU AI Act), de manera que es dona un context d’alta fragmentació reguladora, que està comportant nombrosos problemes derivats de l’escalabilitat limitada dels sistemes d’IA. En aquest escenari, els governs locals juguen un paper més aviat limitat: ni regulen, ni inverteixen en el desenvolupament dels sistemes esmentats. Per contra, és la indústria qui promou iniciatives d’autoregulació voluntària, i és també qui decideix quines aplicacions desenvolupa. Ho fa, tanmateix, seguint criteris comercials, que no necessàriament tenen en compte els beneficis (o els perjudicis) socials. Es produeix un entorn de baixa accessibilitat al desenvolupament i l’ús de sistemes algorísmics, que s’explica per un context de governança complex i fragmentat, que dificulta l’escalabilitat de molts productes d’IA a diversos contextos, excepte per a les empreses grans i amb millors recursos. Això acaba repercutint en uns nivells molt baixos d’adopció: existeix un ecosistema de dades balcanitzat, que comporta una IA amb un rendiment limitat i de baixa qualitat. Així mateix, acaben arribant al mercat molts productes defectuosos i poc segurs, cosa que fa baixar els nivells de confiança i d’ús dels sistemes algorítmics de diverses organitzacions.

Riscos, oportunitats i escenaris de futur desitjables

Tal com s’ha apuntat anteriorment, l’elaboració d’escenaris es concep com un instrument no de predicció de futur, sinó de debat i de reflexió. Específicament, en l’exercici dut a terme en el marc del seminari s’ha buscat donar resposta a tres preguntes fonamentals: (1) quins futurs podrien ser més desitjables que d’altres?; (2) quins riscos i oportunitats s’espera que es puguin materialitzar en cadascun d’aquests escenaris des de la perspectiva dels governs locals?; (3) com es podrien gestionar els riscos associats a cadascun d’aquests escenaris? En definitiva, es tracta de reflexionar sobre com, en un context marcat per nombroses incerteses, els governs locals poden garantir una supervisió democràtica dels sistemes algorísmics utilitzats.

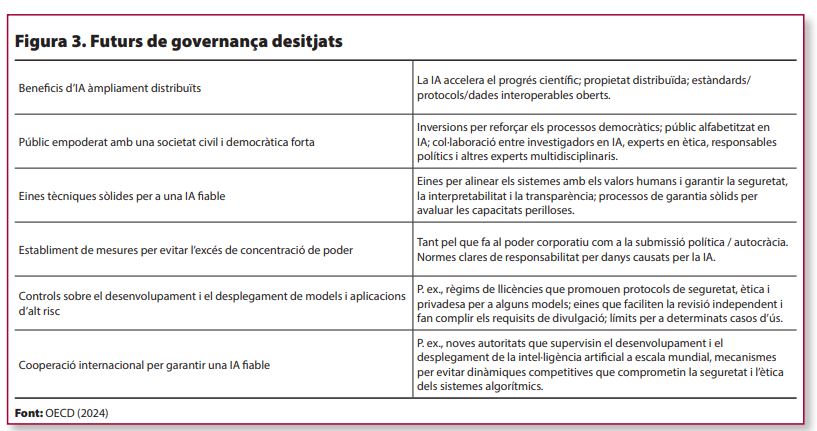

Començant per la primera qüestió, relativa als futurs desitjables, es podria argumentar que l’escenari de la IA sostenible és el que potser reuneix més elements que podrien ser favorables a un desplegament responsable de sistemes algorísmics a escala local i metropolitana. A continuació es resumeixen aquests elements, que podrien ser tinguts en consideració en els processos de reflexió estratègica i d’incidència política que es puguin impulsar des de l’AMB.

Més enllà de la identificació dels futurs desitjables, de l’anàlisi dels diferents contexts que dibuixen els quatre escenaris plantejats es deriven un seguit d’implicacions per als governs locals. Per exemple, és plausible pensar que, en un context on existeix cert consens global a l’entorn dels principis ètics i/o els estàndards tècnics que han de guiar el desenvolupament de la intel·ligència artificial, sigui més fàcil generar marcs reguladors sòlids i millorar l’acceptació general dels sistemes algorísmics. Això podria permetre que els governs locals desenvolupessin i despleguessin solucions basades en IA per a la gestió urbana de manera més segura, sense topar amb les reticències de la ciutadania.

En aquest escenari, les administracions públiques (també les locals) hauran d’establir marcs viables per a les certificacions, les auditories i els controls que han de garantir el compliment de les diferents normatives. Per tant, caldrà assignar recursos per reforçar l’ecosistema (nacional, regional i local) de la IA, com també millorar la capacitat tècnica dels responsables de les agències governamentals directament o indirectament implicats en el desplegament de sistemes algorísmics. A més, és possible que aquest sigui un context procliu a l’augment de programes de finançament i capacitació tècnica vers els governs locals perquè puguin assumir les responsabilitats que els pertoquin, però també a la proliferació de col·laboracions amb el sector privat i les universitats.

Per contra, en un context de governança global fragmentada i de proliferació incontrolada de sistemes algorísmics, possiblement, els governs hauran d’idear estratègies per integrar els esforços de desenvolupament d’IA en un entorn més inestable i incert. Per fer-ho, caldran enfocaments flexibles i adaptatius, amb l’objectiu de reduir les complexitats reguladores innecessàries. D’altra banda, previsiblement augmentaran els ciberatacs, i els municipis (en especial els petits o els mitjans) no sempre estaran preparats per fer-hi front. Així mateix, aquest és l’escenari que planteja més reptes de cara a la protecció de les dades i dels drets digitals de la ciutadania, fet que accentuarà la necessitat de promoure marcs locals de governança de la IA alineats amb valors democràtics.

Per últim, podríem pensar que un context d’alta accessibilitat possiblement facilitaria la proliferació de desenvolupadors més petits, també locals, que podrien adaptar els sistemes algorísmics a les necessitats específiques de cada municipi. Per contra, en aquells escenaris caracteritzats pel domini de les grans multinacionals en el mercat de productes d’IA, els governs locals tindrien una menor capacitat per adquirir productes personalitzats, adequats al seu context específic.

Com garantir una supervisió democràtica dels sistemes algorísmics i una distribució satisfactòria dels beneficis de la IA?

Existeix un consens generalitzat a l’entorn de l’exigència inajornable de reformar l’actual model d’administració pública, per fer-la més eficient, transparent i centrada en les necessitats de la ciutadania. L’accessibilitat creixent de tecnologies revolucionàries com la IA obre noves oportunitats per avançar cap aquesta direcció, però només si els processos de digitalització van acompanyats de les mesures necessàries per transformar també les lògiques de funcionament de l’administració. En altres paraules, no solament cal digitalitzar, sinó que també cal transformar. Davant l’auge i la popularitat que han adquirit les tecnologies d’intel·ligència artificial, molts governs locals han de gestionar dues realitats que sovint conviuen dins d’una mateixa organització: d’una banda, l’optimisme desmesurat en les potencialitats dels sistemes algorísmics per resoldre-ho tot; de l’altra, els discursos apocalíptics sobre els riscos associats amb l’ús d’aquestes tecnologies, que en poden frenar l’adopció.

En aquest context, resulta més pertinent que mai intentar donar respostes a la qüestió de com garantir una supervisió democràtica dels sistemes algorísmics que asseguri una distribució satisfactòria dels beneficis associats amb l’ús de la IA per part de les administracions locals. Una primera proposta en aquesta direcció és desplaçar el debat sobre si cal regular o no, i focalitzar-lo, d’una banda, a comptar amb bones regulacions i, de l’altra, a assegurar la implementació efectiva de les que ja tenim. Per exemple, no calia esperar a tenir l’AI Act per prohibir els sistemes de puntuació social, perquè altres normatives europees com el Reglament general de protecció de dades ja impedien aquest tipus de pràctiques. Per contra, diversos experts han avisat reiteradament que algunes exigències de les normatives europees només les podran aplicar les grans corporacions, no les empreses petites i mitjanes. Aquesta mateixa reflexió podria ser extrapolable als governs locals: tenir regulacions amb un nivell d’exigència molt elevat pot comportar un alt percentatge d’incompliment. De fet, en alguns casos, fins i tot, podria ser desitjable que l’administració pública pogués assumir els riscos raonables que tot procés de transformació digital comporta.

D’altra banda, per garantir la implementació efectiva de les normatives europees, nacionals i regionals és important tenir organismes reguladors —com el Centre Europeu per la Transparència Algorítmica (ECAT) o l’Agència Nacional de Supervisió de la Intel·ligència Artificial— que funcionin amb tot el seu potencial. També seria desitjable que poguessin oferir assistència tècnica i orientacions pràctiques dissenyades específicament per a governs locals. En aquest sentit, cal dotar les administracions locals amb més eines pràctiques que garanteixin un ús responsable dels sistemes algorísmics. Per exemple, molts organismes tenen estratègies de governança sobre la IA, però encara són poques les administracions locals que hagin implantat registres públics d’algorismes o que duguin a terme avaluacions ètiques de dades i sistemes d’intel·ligència artificial1.

Finalment, cal invertir esforços en les accions de pedagogia i sensibilització orientades a millorar la comprensió general de la IA i el seu impacte, tant entre els equips humans municipals com entre la ciutadania, així com fomentar iniciatives que n’assegurin la participació en el desplegament segur i ètic dels sistemes algorísmics. Val a dir que no és necessari que aquestes accions les dugui a terme l’administració pública, ja que sovint no té les eines ni el coneixement imprescindibles. Per contra, podria ser molt més efectiu afavorir aliances amb organitzacions com Xnet o CIVICAi, amb una trajectòria acreditada en la defensa dels drets digitals, la protecció dels quals és més important que mai sigui quin sigui el futur de la IA cap al qual acabem avançant.

Referències bibliogràfiques

Almonacid, V. (2024). «Reglamento (europeo) de Inteligencia Artificial: impacto y obligaciones que genera en los Ayuntamientos». El Consultor de los Ayuntamientos, 15 de julio de 2024, LA LEY. Diario LA LEY, n.º 10553, Sección Tribuna, 24 de juliol de 2024, LA LEY.

Ben Dhaou, S.; Isagah, T.; Distor, C. i Ruas, I. C. (2024). Global assessment of Responsible Artificial Intelligence in cities: Research and recommendations to leverage AI for people-centred smart cities. Nairobi, Kenya. United Nations Human Settlements Programme (UN-Habitat).

Economist Impact (2024). AI landscapes: Exploring future scenarios of AI through to 2030. London: Economist impact (en línia) [data de consulta: 30.11.2024] https://impact.economist.com/projects/what-next-for-ai/ai-landscapes/

Galceran-Vercher, M. y Vidal, A. (2024). «Mapatge de la intel·ligència artificial urbana: primer informe de l’Atles de la Intel·ligència Artificial Urbana del GOUAI». CIDOB Briefings, n.º 56.

OECD (2024). «Assessing potential future artificial intelligence risks, benefits and policy imperatives». OECD Artificial Intelligence Papers, núm. 27 (novembre del 2024).

PWC (2020). The many futures of Artificial Intelligence: Scenarios of what AI could look like in the EU by 2025. Març del 2020.

United Kingdom Government Office for Science (2023). «Future Risks of Frontier A: Which capabilities and risks could emerge at the cutting edge of AI in the future?». Department for Science, Innovation and Technology. Government of the United Kingdom (octubre del 2023) (en línia) [data de consulta: 30.11.2024] https://assets.publishing.service.gov.uk/media/653bc393d10f3500139a6ac5/future-risks-of-frontier-ai-annex-a.pdf

Notes:

1- Aquesta és una normativa germana de la Llei general de protecció de dades (LGPD) del maig del 2018, perquè no hi ha intel·ligència artificial sense dades.

2- Un estudi recent apunta que fins a un 20% dels directors tecnològics i més del 55% dels treballadors municipals d’una mostra de 122 ciutats d’arreu del món estan desenvolupant projectes d’IA sense els coneixements i l’experiència prèvia necessaris (Dhaou et al., 2024).

3- El model d’autoavaluació PIO (Principis, Indicadors i Observables), dissenyat per l’Observatori d’Ètica en Intel·ligència Artificial de Catalunya (OEIAC), podria ser fàcilment implementat en moltes administracions locals, per exemple.

Totes les publicacions expressen les opinions dels/de les seus/ves autors/es i no reflecteixen necessàriament els punts de vista del CIDOB o dels seus finançadors