Oportunidades desde la economía social en la lucha contra las amenazas de la IA

Miguel Guillén Burguillos , profesor asociado y coordinador de proyectos de la Cátedra de Economía Social, Tecnocampus-Universitat Pompeu Fabra (UPF); investigador predoctoral, Universitat de les Illes Balears. mguillen@tecnocampus.cat. ORCID: https://orcid.org/0009-0003-2264-6603

Eloi Serrano Robles, director de la Cátedra de Economía Social, Tecnocampus-UPF; investigador asociado, CIDOB. eserrano@tecnocampus.cat. ORCID: https://orcid.org/0000-0002-3821-2944

Las empresas de economía social no pueden renunciar al uso de la inteligencia artificial (IA), pues esta es útil en diferentes tareas empresariales. La clave está en hacerlo según los principios de la economía social y promover un desarrollo de la IA según estos valores, poniendo a las personas en el centro de la actividad económica. Así, la economía social puede jugar un papel importante a la hora de democratizar la IA, ya que desarrolla sus actividades con base en principios como la ética, la justicia, la gestión democrática, la equidad, la sostenibilidad y la defensa de los intereses de las personas, sus comunidades y sociedades, más allá de los beneficios económicos. Teniendo en cuenta esta premisa, este artículo examina las amenazas del desarrollo actual de la IA y propone algunas oportunidades que ofrece la economía social para que este desarrollo parta de criterios más éticos y democráticos.

Este artículo examina el papel y las oportunidades que la economía social puede ofrecer para la democratización del desarrollo de la inteligencia artificial (IA), planteando las siguientes cuestiones: ¿es posible identificar dichas oportunidades? Y, de ser así, ¿cuáles son? La hipótesis de partida es que el modelo empresarial de la economía social puede ofrecer diferentes oportunidades para democratizar la IA. Para ello, resulta necesario identificar primero las amenazas que suscita el actual desarrollo de la IA.

A raíz de la Gran Recesión de 2008, las prácticas de las grandes empresas privadas y también de los reguladores públicos enfrentaron una crisis de legitimidad debido a diversas conductas ilícitas y antisociales, tales como la corrupción, el falseamiento de cuentas y la venta de productos financieros tóxicos, entre otras. Al mismo tiempo, siempre han existido niveles históricos de desigualdad y pobreza, y la empresa tradicional no ha ofrecido respuestas adecuadas a las nuevas demandas sociales (Chaves y Monzón, 2018). Es aquí donde el modelo empresarial de la economía social aparece como una alternativa al tradicional. La apuesta por esta opción de organización empresarial está basada en los siguientes principios: 1) adhesión voluntaria, 2) gestión democrática por parte de los socios, 3) participación económica de los socios, 4) autonomía e independencia, 5) educación, formación e información, 6) intercooperación y 7) interés por la comunidad (Serrano, 2019). Cuando se habla de que esta transición digital de la IA ha de ser necesariamente compatible con la democracia, las formas de organización empresarial basadas precisamente en este principio de la gestión democrática deben jugar un papel protagonista.

Si bien el estudio de la relación entre la economía social y la IA aún no es muy prolífico, existe literatura que analiza la manera en que los principios y valores cooperativos resultan pertinentes para potenciar una IA relacional que supere los efectos adversos en personas y territorios de una IA basada solo en valores capitalistas (Monreal, 2023). La economía social no es ajena a las oportunidades y amenazas de la IA y, para entender estas últimas, se debe hacer referencia a los intereses del sistema capitalista en un contexto de globalización, donde los objetivos de las grandes corporaciones financieras y tecnológicas en la mal llamada economía colaborativa escalan a todos los niveles, también cuando nos referimos a la IA (Sachs, 2020). Ello da como resultado un debilitamiento de las economías y las democracias locales (Sassen, 2014), bajo una ideología económica basada, por un lado, en el crecimiento económico agresivo y, por otro, en un sistema de valores individualistas indiferentes al respeto al medio ambiente o a cualquier otra consideración sobre justicia social (Monreal, 2023).

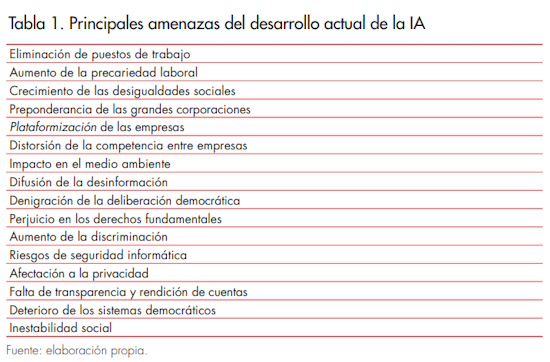

Para analizar este fenómeno, este artículo se estructura de la siguiente forma: en primer lugar, se ofrecen algunos conceptos clave relacionados con la IA; en segundo lugar, se efectúa un análisis de las potenciales amenazas que pueden surgir, tales como las relacionadas con el desempleo y desigualdades sociales, el poder de las grandes corporaciones, la privacidad y explotación de datos, el deterioro de los sistemas democráticos e inestabilidad social, la discriminación por origen y género o el impacto medioambiental; en tercer lugar, se aborda la regulación de la IA que se está llevando a cabo desde las instituciones públicas, y, por último, se dedica un apartado a las oportunidades desde la economía social en el desarrollo de la IA, para terminar con unas conclusiones.

Desarrollo de la IA y modelos de negocio

Conceptos clave de la IA

Definimos la IA como aquel conjunto de sistemas de software y hardware diseñados por humanos que, ante un objetivo complejo, «actúan en la dimensión física o digital: percibiendo su entorno, a través de la adquisición e interpretación de datos estructurados o no estructurados, razonando sobre el conocimiento, procesando la información derivada de estos datos y decidiendo las mejores acciones para lograr el objetivo dado» (Samoili et al., 2020). En este campo, es también importante definir el concepto de datificación, considerado como un «fenómeno contemporáneo que se refiere a la cuantificación de la vida humana a través de información digital, muy a menudo con fines económicos» (Mejías y Couldry, 2022). Otro concepto básico es el de la plataformización, que se define como «la penetración de infraestructuras, procesos económicos y marcos gubernamentales de plataformas digitales en diferentes sectores económicos y esferas de la vida, así como la reorganización de las prácticas culturales y los imaginarios en torno a estas plataformas» (Poell et al., 2019).

Por su parte, las «infraestructuras de datos» hacen referencia a aquellos flujos y prácticas materiales, semióticas y sociales que: 1) traducen cosas en números (datificación); 2) almacenan, transmiten, analizan y representan datos utilizando lógicas algorítmicas y tecnologías computacionales; 3) integran el uso de datos en una variedad de prácticas; 4) producen nuevos espacios y operaciones de poder a través de prácticas de clasificación, medición y comparación, y 5) generan nuevas prácticas sociales y problematizaciones de lo social, así como nuevas formas de gobernanza (Gulson et al., 2019). Al hablar de datificación, es pertinente tener en cuenta el papel que juegan actualmente los activistas del movimiento de datos abiertos, quienes se encargan de rearticular la noción de democracia, participación y periodismo al aplicar prácticas y valores de la cultura de código abierto a la creación y uso de datos (Baack, 2015). Para este autor (ibídem), las prácticas e ideas de los activistas de datos abiertos son relevantes, ya que conectan datificación y cultura de código abierto, ayudando también a entender cómo la datificación podría apoyar la acción de públicos y actores no gubernamentales y las grandes empresas. Esta cuestión es especialmente interesante y entronca con dos cuestiones que trataremos más adelante: la regulación de la IA y el papel de las grandes corporaciones.

Van Dijck (2014) aborda el concepto de dataísmo, al considerar que los metadatos y los datos se han convertido en una moneda habitual para que los ciudadanos paguen por sus servicios de comunicación y seguridad; una disyuntiva que se ha instalado en la zona de confort de la mayoría de personas. En su trabajo, este autor intenta deconstruir los fundamentos ideológicos de la datificación, que tiene sus raíces en afirmaciones ontológicas y epistemológicas problemáticas. Como parte de una lógica más amplia de las redes sociales, la datificación muestra características de una creencia secular generalizada, el llamado «dataísmo», que tiene tanto éxito porque multitud de personas –ingenua o inconscientemente– confían su información personal a plataformas corporativas (ibídem).

Otra cuestión cada vez más presente es la referente a la «equidad algorítmica». El hecho de que, cada vez más, la toma de decisiones algorítmica influye en la vida cotidiana de las personas y cómo estos sistemas autónomos pueden causar graves daños a individuos y grupos sociales ha propiciado preocupaciones sobre la equidad (Starke et al., 2022). Es un enfoque centrado en las personas que se viene reclamando cada vez con mayor insistencia y que puede ser una clara oportunidad para la intervención del modelo empresarial de la economía social que, como hemos explicado, sitúa en el centro de su actividad a la persona, por encima del capital.

Modelos de negocio en el desarrollo de la IA

Respecto a casos concretos de grandes corporaciones desarrolladoras de IA, nos detendremos a examinar empresas como LinkedIn y Meta. En el caso de la primera, se utilizan funciones impulsadas por IA que pueden generar perfiles personalizados, con el riesgo de crear perfiles falsos o manipular información personal. También existen sistemas de contratación automatizados que utilizan pruebas de personalidad algorítmicas, las cuales gestionan información obtenida de pruebas psicométricas, que permiten descubrir rasgos de personalidad a través de los cuales es posible predecir un éxito futuro según currículum o perfil en redes sociales de los usuarios (Rhea et al., 2022). Estamos hablando de herramientas de IA que se utilizan en LinkedIn como CrystalKnows, Dux-Soup, FinalScout, Social Pilot, Mention, Travisnine, Jobscan, People.ai, LinkedIn Talent Insights, Textio, LinkedIn Campaign Manager, Shield, LinkedIn Learning o LinkedIn Analytics (Sharpa Marketing, 2017). Por su parte, Meta, proveedora de Facebook, Instagram o WhatsApp, utiliza una gran variedad de fuentes procedentes de terceros, incluida información disponible públicamente, para así entrenar sus modelos de IA. Y, aunque recientemente ha añadido opciones para que el usuario pueda limitar el uso de su información personal, ello ha sido únicamente para los datos obtenidos a través de terceros, es decir, aquella información que la empresa obtiene a través de otras empresas con las que colabora. Esto quiere decir que el resto de datos generados por los usuarios seguirán disponibles para ser utilizados por parte de Meta para entrenar su IA (Maldita.es, 2023).

Estas empresas se lucran, de esta forma, de los datos que generan los millones de usuarios que tienen alrededor del mundo. Al aceptar la política de privacidad al darse de alta en la plataforma, con un solo clic el usuario muchas veces no es consciente de todo lo que ello comporta. El servicio, a menudo gratuito, siempre precisa de una contraprestación a la que no se otorga toda la importancia que merece: la cesión de los datos emitidos continuamente y de forma dinámica. Meta alcanzó un beneficio neto de 12.369 millones de dólares en el primer trimestre de 2024, más del doble (116,7%) que en el mismo período del ejercicio anterior (Europa Press, 2024).

Amenazas del desarrollo actual de la IA

Yuval Noah Harari (citado en Barranco, 2024) explica que con la IA el ser humano ha creado «una nueva inteligencia potencialmente más poderosa e inteligente que nosotros. Y si se sale de nuestro control, las consecuencias podrían ser catastróficas». Se abren cientos de escenarios muy peligrosos, porque estamos ante una herramienta que no está en nuestras manos; se están librando millones de nuevos agentes autónomos que podrían volverse más inteligentes que nosotros, por lo que no podemos anticipar ni controlar lo que harán. Además, no estamos hablando únicamente de una tecnología que copia y replica ideas, sino que es capaz de crear ideas propias y también tomar decisiones. Para Harari, «los algoritmos ya han matado a gente»; aunque estos tengan solamente un 1% de responsabilidad, es la primera vez en la historia que las decisiones de la IA sobre qué información difundir han contribuido a un importante cambio histórico (ibídem).

Desempleo y desigualdades sociales

Si bien la IA ofrece numerosas oportunidades, también aparecen nuevas amenazas, como la robotización del trabajo. Existe literatura que aborda la idea del «reemplazamiento» y la amenaza de ser sustituidos por máquinas. Daniel Innerarity (2022: 31) considera que este sentimiento no sería correcto, ya que «las máquinas reemplazan tareas, pero no ocupan puestos de trabajo, son dos cosas distintas: una cosa es el task y otra cosa es el job, una cosa es el puesto de trabajo y otra cosa es la tarea». La proliferación de la IA y otras formas de cambio tecnológico que reemplazan a los trabajadores puede ser inequívocamente positiva en una economía óptima en la que los individuos están totalmente asegurados contra cualquier efecto adverso de la innovación, o si ello va acompañado de la forma correcta de redistribución. Pero el cambio tecnológico que reemplaza a los trabajadores puede no solo conducir a estos a obtener una fracción cada vez menor del ingreso nacional, sino que puede empeorar su situación en términos absolutos (Korinek y Stiglitz, 2019). La robotización tendría como consecuencia un progresivo «crecimiento masivo del desempleo, creciente desigualdad y mayor crecimiento de la productividad a través de la automatización» (Gries y Naudé, 2018). Y, aunque aún no se dispone de evidencia científica suficiente para aseverar con seguridad que la IA causará pérdidas masivas de empleos, es cierto que, a la vez que se está produciendo un crecimiento más rápido de la productividad y el PIB, el crecimiento de los salarios y la productividad se están estancando, mientras la desigualdad aumenta. Aquí es donde aparece una de las claves: «si los ingresos laborales no se benefician de las ganancias económicas generadas por el progreso en IA, el consumo puede estancarse y restringir el crecimiento» (ibídem).

En este contexto, los sistemas algorítmicos y la IA juegan un papel fundamental en la distribución de bienes y resultados; por eso, pueden tener una afectación importante en la reproducción de desigualdad en el futuro (Zajko, 2022). La equidad, como elemento central del desarrollo sostenible, no puede desligarse de las formas y modelos que generan la dispersión en la posesión o percepción de la riqueza (Serrano, 2024). La literatura científica no es muy prolífica en analizar las raíces microeconómicas o el papel del modelo empresarial en la generación de esas desigualdades, por lo que, en este sentido, tampoco se identifica la economía social, las cooperativas y las sociedades laborales como agentes correctores que puedan contribuir a reducir la desigualdad. Podemos afirmar que las cooperativas diluyen el conflicto entre el capital y el trabajo, ya que la condición de socio cooperativista sitúa en un mismo sujeto la percepción de los rendimientos derivados del trabajo y los rendimientos del capital (doble condición trabajador-propietario) (ibídem). Piketty (2014) hace referencia a la cultura emprendedora de nuestro tiempo, y aquí hay que pensar inevitablemente en Silicon Valley y en diferentes empresarios concretos cuyas fortunas siguen aumentando año tras año, junto con la «tendencia r>g», esto es, la tasa de retorno sobre el patrimonio es mayor que la tasa de crecimiento, lo que nos lleva a un incremento automático del capital inicial, que provocará que las fortunas crezcan y se perpetúen hasta límites que sobrepasen la utilidad social (Lobato, 2014).

Además de la eventual eliminación de tareas que hoy desarrollan personas a causa del desarrollo de la IA, otro de los grandes riesgos es la plataformización de las empresas, ya que los trabajadores actuarían como falsos autónomos que facturan sus servicios a la plataforma en cuestión, si bien con una relación laboral exclusiva y permanente. La Confederación Europea de Sindicatos (CES) calcula que actualmente hay 28 millones de personas en Europa en esta situación: personal laboral sin capacidad de negociar de forma colectiva sus condiciones de trabajo (Cruz, 2023).

El poder de las grandes corporaciones

Nos encontramos ante un futuro marcado por la presencia de una lógica económica sin precedentes que aspira a dominar la siguiente modernidad, con origen en Silicon Valley (Zuboff, 2020). Convivimos con la cara oculta de las prácticas de estas grandes empresas sin reparar en ellas por su cualidad etérea, imperceptibles a simple vista. Existe un «capitalismo de la vigilancia» (ibídem), enfocado hacia un futuro gobernado desde la alegalidad por Google, Facebook, Amazon y otras grandes empresas de internet e IA que explotan la experiencia humana sin consentimiento y vulneran el derecho a la privacidad del individuo (Moscardó, 2021). El papel preponderante de las grandes corporaciones de Silicon Valley puede comportar determinadas amenazas sociales: intensificación de la desigualdad y la jerarquización social, mayor exclusión, usurpación de derechos y eliminación de la vida personal en todo aquello que la hace justamente personal. Los actos de desposesión digital que cometen los capitalistas de la vigilancia «imponen una nueva forma de control sobre individuos, poblaciones y sociedades enteras» (Zuboff, 2020). Todo ello tiene su base en la posición envidiable de las grandes empresas tecnológicas, que durante 20 años han utilizado todo tipo de fórmulas de extracción de datos a bajo precio, de manera que hoy en día pocas instituciones, incluidas las administraciones públicas, pueden competir con ellas, a la vez que han recibido cuantiosas ayudas públicas (Morozov, 2018).

El «capitalismo ahora está muerto» y su dinámica ya no rige nuestras economías, ya que su papel ha sido reemplazado por algo fundamentalmente diferente, el «tecnofeudalismo» (Varoufakis, 2023). Lo que ha matado al capitalismo es el capital mismo, una mutación causada por: 1) la privatización de Internet por parte de las grandes tecnológicas de Estados Unidos y China, y 2) la manera en que Occidente, los gobiernos y los bancos centrales respondieron a la gran crisis de 2008. Todo ello habría demolido los dos grandes pilares del capitalismo: los mercados y las ganancias. Así, los mercados han sido reemplazados por las plataformas digitales comerciales, que son feudos; por lo que respecta a las ganancias, estas han sido sustituidas por su predecesor feudal, el alquiler (ibídem). El término «tecnofeudalismo» ya había sido utilizado anteriormente por otros autores. Para Durand (2021a), las plataformas están en vías de convertirse en feudos, y quien controla estas infraestructuras concentra un poder, tanto político como económico, sobre quienes están vinculados a ellas. Nos encontraríamos, así, en una fase senil del capitalismo donde existiría una captura de rentas por parte de estas plataformas y grandes empresas digitales (Cairó, 2022; Durand, 2021b).

Si nos detenemos en la ética empresarial, también existen amenazas tales como, entre otras, la falta de transparencia y aplicabilidad de los sistemas de IA, la ausencia de rendición de cuentas, las prácticas manipuladoras de marketing o los mecanismos que inducen a la adicción (Masut y Schmidt, 2024).

Privacidad y explotación de datos

Existen las amenazas de las tecnologías de IA en lo correspondiente al derecho a la privacidad como, por ejemplo, la existencia de un ecosistema en expansión de recopilación e intercambio de datos personales, en gran medida no transparentes. Estos sistemas afectan a los enfoques gubernamentales en materia de vigilancia y administración de justicia, determinan la accesibilidad de los servicios públicos, deciden quién tiene posibilidades de ser contratado para un puesto de trabajo y afectan a la información que las personas ven y pueden compartir en línea, por ejemplo. Además, se produce un claro riesgo de discriminación vinculado a las decisiones basadas en la IA (Naciones Unidas, 2021), pudiendo existir acciones perjudiciales tales como perfilamientos, vigilancia, ataques cibernéticos y afectaciones a la capacidad de decisión de los propios usuarios. Por ejemplo, cuando estos comparten sus datos con determinadas empresas a través de Internet, muchas veces no saben si la información que están facilitando será vendida a terceros o si los sistemas de IA que recolectan dicha información están cifrados o encriptados (Murrugarra, 2024).

La IA permite la recopilación de grandes cantidades de datos personales de todo tipo (búsquedas en la red, hábitos de consumo, etc.), que permite la creación de perfiles de usuarios detallados, lo que representa una amenaza para la privacidad. Al respecto, es tan importante la regulación por parte de los poderes públicos como la implementación de prácticas éticas por parte de las empresas, así como una concienciación mayor de los usuarios a la hora de ceder sus datos a estas empresas (Alfonso et al., 2023).

Deterioro de los sistemas democráticos e inestabilidad social

Aguirre (2021) advierte de que «las tecnologías digitales, y en concreto la IA, lejos de mejorar la democracia y la participación ciudadana, algunos de sus usos han conducido a la denigración de la deliberación democrática». Uno de los desafíos éticos principales son la falsedad y la saturación de información, que fomentan la promoción de emociones concretas e interesadas, carentes de transparencia, lo que puede condicionar la deliberación democrática necesaria para votar, promover iniciativas legislativas, etc. Esto lleva a la posverdad e infoxicación, que pueden comportar que la ciudadanía confunda realidad virtual con vida real colectiva (ibídem). Por ello, la teoría deliberativa de la democracia ofrece «el mejor marco en el que organizar la conversación para corregir la supuesta objetividad algorítmica con las plurales preferencias de los humanos» (Innerarity, 2023a). Según Harari, en Estados Unidos se dispone de la tecnología de la información más sofisticada de la historia, pero sus ciudadanos están perdiendo la capacidad de hablar entre sí y escucharse. Y aquí la sospecha es que esta tecnología, en lugar de facilitar la comunicación, la dificulta, porque además existen muchas voces no humanas; es decir, muchas entidades tecnológicas han entrado en el debate; por ejemplo, se calcula que más del 20% del contenido de X (antiguo Twitter) lo difunden bots. Esto es, los algoritmos que deciden qué voces amplificar y silenciar no son humanos (Harari, citado en Barranco, 2024). En este contexto, el papel de los medios de comunicación es fundamental a la hora de definir el proceso deliberativo en los sistemas democráticos. Nikunen y Hokka (2019) estudian cómo los medios de servicio público –que consideran parte del Estado de bienestar– y sus valores de universalidad, igualdad, diversidad y calidad se ven afectados por la datificación y un entorno de medios de comunicación de plataforma. Inquieta que sean los algoritmos los enterradores de la democracia.

Innerarity (2022) se pregunta si estamos entrando en un nuevo totalitarismo de la mano de la ideología de la optimización, y si siguen teniendo sentido la información razonada, la decisión propia y el autogobierno democrático en esos nuevos entornos tecnológicos. Así, hay quien denuncia un big nudging: gigantesco sistema de información superinteligente, central y tecnocrático, que representaría una forma de dictadura en la medida en que vaciaría de contenido decisional a nuestras organizaciones políticas (Helbing et al., 2017). Por ello, «no deberíamos minusvalorar el riesgo de que el tecnoautoritarismo resulte cada vez más atractivo en un mundo en el que la política cosecha un largo listado de fracasos» (ibídem, 2020). Este es uno de los grandes peligros: amplias capas de la sociedad achacan los fracasos de nuestras sociedades al funcionamiento de las democracias liberales, y eso puede comportar la seducción de un discurso basado en una supuesta solución mágica a todos nuestros problemas por parte de las herramientas que nos ofrece la IA, también en lo concerniente a la política. Innerarity (2023b) explica que «en poco tiempo hemos pasado del ciberentusiasmo a la «tecnopreocupación», aunque los datos conducen a un conocimiento que seguirá siendo rebatible y humano. Demasiado humano». En política, las decisiones deben tomarlas las personas y no las máquinas (Innerarity, 2022). La falta de información, la tergiversación de noticias y las fuentes carentes de fiabilidad pueden suponer un sesgo claramente perjudicial a la hora de tomar decisiones.

Discriminación por origen y género

La amenaza de la discriminación por cuestión de origen o género es también capital, ya que la IA se nutre de datos generados en una sociedad históricamente discriminatoria. Para luchar contra esta situación, se han propuesto varias técnicas para lograr la imparcialidad algorítmica: el llamado «algoritmo sin restricciones» maximiza la seguridad pública y al mismo tiempo satisface un concepto importante de igualdad, es decir, que todos los individuos estén sujetos al mismo estándar, independientemente de su origen (Corbett-Davies et al. 2017). Respecto al género, los datos que los alimentan y los resultados de la toma de decisiones algorítmicas pueden estar sesgados, lo que potencialmente perjudica a las mujeres y perpetúa la discriminación (Gutiérrez, 2021). Así, el sesgo algorítmico de género se puede definir como el cálculo algorítmico basado en datos con una discriminación o invisibilización de las mujeres, creando resultados adversos para ellas. Además, la discriminación de género en la vida real incorporada en los datos puede dar lugar a sesgos en el mundo digital (ibídem, 2021). Por todo ello, los datos históricos no pueden ser la única base para la política algorítmica que afecta a las mujeres y, además, como propuesta, se deberían incluir más mujeres como diseñadoras de algoritmos y también como evaluadoras (ibídem 2021). Como demuestran Zhao et al. (2017), los modelos de predicción estructurados amplifican el sesgo y hay que proponer métodos para reducir este efecto, pero quedan importantes retos para el trabajo futuro. Porque los algoritmos de aprendizaje automático se utilizan en contextos sensibles que afectan el curso de las vidas humanas, como los préstamos de crédito o la justicia penal, por ejemplo, y se sabe que las máquinas «objetivas» basan sus decisiones únicamente en hechos y no se ven afectadas por los sesgos cognitivos humanos, las tendencias discriminatorias o las emociones (Tolan, 2019), y se trata de una cuestión que debe ser tenida en cuenta para no perpetuar discriminaciones de forma injusta.

Impacto medioambiental

También hay que hacer referencia a las amenazas relacionadas con los recursos naturales: consumo energético de los grandes centros de datos, extracción de agua para la tecnología de IA (refrigeración de servidores, etc.), materias primas, generación de residuos (hardware que queda obsoleto rápidamente, liberación al medio ambiente de sustancias como plomo, mercurio y cadmio, etc.) (Masut y Schmidt, 2024). De la misma forma, existe la amenaza de impactar negativamente en el respeto a los derechos humanos: a la vida privada y la intimidad, a la no discriminación, al derecho a la vida, a la libertad y a la seguridad personal, a la libertad de opinión y de expresión, a la protección de la propiedad intelectual, derechos laborales, etc. (ibídem). Uno de los pilares para lograr la transición energética es la transición digital, pero la tecnología digital también requiere de altos consumos de energía (Terrones, citado en Coll, 2024).

Regulación de la IA

Existe la necesidad de regular y controlar la IA, teniendo en cuenta los procesos de rendición de cuentas (Prabhakaran et al., 2022), ya que los riesgos que entraña su progreso son evidentes y la inquietud social puede ir en aumento. Un ejemplo de ello es el recientemente aprobado Reglamento de IA de la UE del 13 de junio de 2024. Tal y como se contempla en su introducción, su objetivo es «mejorar el funcionamiento del mercado interior mediante el establecimiento de un marco jurídico uniforme, en particular para el desarrollo, la introducción en el mercado, la puesta en servicio y la utilización de sistemas de inteligencia artificial (...) en la Unión, de conformidad con los valores de la Unión, a fin de promover la adopción de una IA centrada en el ser humano y fiable, garantizando al mismo tiempo un elevado nivel de protección de la salud, la seguridad y los derechos fundamentales consagrados en la Carta de los Derechos Fundamentales de la Unión Europea (...), incluidos la democracia, el Estado de derecho y la protección del medio ambiente, proteger frente a los efectos perjudiciales de los sistemas de IA en la Unión, así como brindar apoyo a la innovación» (Unión Europea, 2024). Hay que aclarar que esta normativa se aplica a los proveedores de sistemas de IA en el mercado de la Unión Europea (UE), o quienes los ponen en servicio en este territorio; por lo que se puede hablar de impacto global. Sin embargo, no se aplica a los sistemas de IA desarrollados en la Unión y exportados al exterior. Además, sectores como la aviación civil y la seguridad nacional quedan fuera de este reglamento (Masut y Schmidt, 2024).

Es necesario recordar que, ya previamente, la Comisión Europea había emitido en 2018 una serie de recomendaciones basadas en siete ejes para el desarrollo de las aplicaciones en IA: 1) que la IA no sea autónoma, sino supervisada por especialistas o profesionales; 2) que sea robusta y segura; 3) que respete la privacidad y no haga un uso ilícito de los datos personales o sensibles; 4) que sea transparente; 5) que garantice resultados equitativos y sin sesgos que vulneren los derechos de grupos de personas concretos (mujeres, pobres, ancianos, etc.) ; 6) que esté dirigida al bienestar y que sea sostenible; y 7) que rinda cuentas (Gibert, 2024). En este sentido, el citado reglamento de la UE representa un avance importante en la regulación internacional de la IA. El problema es que son las grandes empresas tecnológicas las que están definiendo el relato, introduciendo sus aplicaciones en ámbitos centrales de nuestra vida; además, la regulación sobre los sistemas de IA se está haciendo a posteriori de un sistema demasiado permisivo (Vallès, entrevistada en Toro, 2024). La ley siempre irá por detrás de la tecnología y es prácticamente seguro que las regulaciones presentes y futuras casi siempre llegarán tarde (Gibert, 2024).

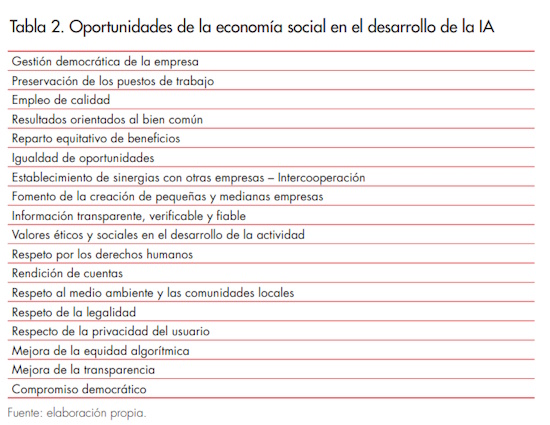

Oportunidades desde la economía social en el desarrollo de la IA

La IA, sin embargo, también ofrece oportunidades, y es probable que la necesitemos para sobrevivir como especie y abordar los retos del siglo xxi: el cambio climático, el transporte eficiente y autónomo, la medicina de precisión o personalizada, entre otros. Todos los grandes descubrimientos científicos solo se podrán llevar a cabo analizando una gran cantidad de datos y, para ello, es necesaria la IA (Oliver, entrevistada en Salicrú, 2024). De la misma forma, para las empresas, la IA puede permitir desarrollar una nueva generación de productos y servicios, particularmente en sectores como la economía verde y circular , maquinaria, agricultura, atención sanitaria, moda, turismo, etc.; puede impulsar las ventas, mejorar el mantenimiento de las máquinas, aumentar la producción y la calidad, mejorar el servicio al cliente y ahorrar energía, etc. Igualmente, la IA que se utiliza en los servicios públicos puede reducir los costes y ofrecer nuevas posibilidades en el transporte público, la educación, la energía y la gestión de residuos, por ejemplo (Parlamento Europeo, 2020).

En este contexto, las empresas de economía social no pueden a renunciar a la IA, pues esta es muy útil en diferentes áreas y tareas: innovación, producción, logística, gestión de personas, etc. La clave está en hacer un uso de estas herramientas basado en los siete principios fundamentales de la economía social enumerados al inicio del presente artículo. Así, las organizaciones que desarrollen aplicaciones y herramientas de IA deberán priorizar los intereses de las personas, basándose en unos valores éticos y sociales y prestando especial atención a la discriminación de las personas y los colectivos, sobre todo en lo concerniente a los puestos de trabajo. En resumen, IA y economía social pueden y deben relacionarse para promover un desarrollo de la IA de potente oportunidad tecnológica, basado en principios como la justicia, la equidad o la sostenibilidad. De hecho, se considera que existe la necesidad de desarrollar la IA de una forma alternativa. Stiglitz (citado en Co-operative News, 2016) ha defendido que las cooperativas, junto con otras iniciativas de la economía social, proporcionan «un tercer pilar clave para remodelar la economía globalizada». Por su parte, Rifkin (citado en Alianza Cooperativa Internacional, 2016) explica que las cooperativas podrían liderar un cambio de paradigma en diferentes sectores, también en el tecnológico, y las alienta a utilizar su dominio web «.coop» y a crear nuevos algoritmos y aplicaciones para utilizar los datos de forma ética, a la vez que incita a los cooperativistas a desarrollar sus propias redes sociales, tipo Facebook, Google, Twitter, o plataformas de transporte.

La economía social puede representar una oportunidad para la democratización de la IA. Con la Cuarta Revolución Industrial, al igual que en las anteriores con el surgimiento de cooperativas, mutuas y asociaciones, se configura un nuevo sector tecnológico con rasgos distintivos al que denominamos «economía digital sostenible» (Pastor, 2022), referente a la idea de que, ante la progresiva crisis de transición ecológica, se necesita algo más que una conciencia social para enfrentarla. Aquí, las cooperativas de datos representan una oportunidad organizativa para empoderar a los individuos y darles el control sobre los datos que comparten, monetizándolos o entregándolos para la investigación. Como ejemplo, encontraríamos Driver’s Seat, una cooperativa de conductores estadounidense que recopila datos relacionados con su trabajo a partir de los teléfonos inteligentes de los conductores de viajes compartidos; o la irlandesa Resonate, que ofrece el primer servicio de transmisión de música propiedad de la comunidad de músicos; o la española Salus.coop, una cooperativa de donantes de datos para la investigación para el Bien Común (ibídem).

Si en el apartado de las amenazas del desarrollo de la IA hacíamos referencia a los medios de comunicación, aquí estos aparecen como una nueva oportunidad, ya que existe la opción de implementar modelos de economía social en medios de comunicación, constituyendo cooperativas de periodistas, por ejemplo. La crisis del sector ha llevado a reducciones de plantillas en medios de comunicación tradicionales, y existen ejemplos de periodistas que, al perder su puesto de trabajo, han optado por constituir empresas de economía social a fin de seguir desarrollando su actividad profesional, creando nuevos medios basados en principios de gestión democrática, ética, etc. Zia (2023) afirma que la democratización de la IA consiste en ponerla al alcance de todos, independientemente de su procedencia o recursos. El objetivo clave es ofrecer a todo el mundo las mismas oportunidades de beneficiarse de la IA para «potenciar la innovación y fomentar la creatividad». Para este autor, ello implica aspectos como la accesibilidad, la educación y formación, la colaboración y apertura o las consideraciones éticas. Así, existirían diferentes tipos de democratización de la IA: de datos, de algoritmos, de informática y del conocimiento. Las ventajas de la democratización de la IA son múltiples: reducción de la escasez de competencias, eficiencia de costes, consecución de una mayor productividad, mejora de la innovación empresarial, así como la eliminación de barreras, es decir, personas de todo el mundo, independientemente de su situación financiera, podrían iniciar su andadura en la IA (ibídem). Aquí, nuevamente, el papel de la economía social puede ser importante.

En la democratización de la IA sería pertinente plantear la consecución de un desarrollo de sus herramientas centrado en las personas y sus intereses. Ello no debe ir reñido necesariamente con la pérdida de eficiencia o incluso de generación de beneficios económicos, pues hay numerosos ejemplos de empresas de economía social a nivel global que, a la vez que sitúan en el centro de su actividad a las personas, son capaces de funcionar de forma eficiente y generar beneficios económicos que repercutirán positivamente en sus socios y también en las comunidades y sociedades en las que actúan. Un funcionamiento de la IA basado en los valores de la economía social, sin duda alguna minimizaría los riesgos y amenazas que existen a la hora de repartir el beneficio que representa la IA a nivel empresarial. El papel de las administraciones públicas, en este sentido, se antoja fundamental, tanto en lo que respecta a la regulación de la IA como en lo correspondiente al fomento y soporte de iniciativas empresariales que respeten los derechos de las personas y el medio ambiente.

Conclusiones

La democratización de la IA significa, en primer lugar, que esté al alcance de todo el mundo, independientemente de sus antecedentes o recursos (Zia, 2023). Asimismo, es fundamental que el desarrollo de la IA no implique una acumulación de riqueza en pocas manos, en ese «capitalismo de la vigilancia» (Zuboff, 2020) que avanza hacia un futuro disruptivo gobernado desde la alegalidad por grandes corporaciones como Google, Facebook o Amazon, las cuales, a su vez, se benefician de recursos públicos desde instituciones muchas de las cuales son democráticas. Si el desarrollo de la IA, en constante evolución y progreso a un ritmo vertiginoso, se deja en manos de tan solo unas pocas empresas, el beneficio económico generado repercutirá en una minoría, aumentando las desigualdades sociales y excluyendo a las capas sociales más desfavorecidas. Asimismo, dado que la robotización implicará inevitablemente la eliminación de tareas que tradicionalmente desarrollaban personas, se debería garantizar, desde las instituciones públicas, que el modelo «tecnofeudalista» (Varoufakis, 2023) en el que nos encontramos no continúe beneficiando exclusivamente a unos pocos privilegiados.

La regulación de la IA resulta imprescindible ante las eventuales amenazas actuales. Lo cierto es que existe un desequilibrio en el desarrollo de la IA y su marco regulatorio a nivel internacional. Todo ello supone que los ordenamientos jurídicos nacionales queden comprometidos y haya que replantear los mecanismos de gobernanza, adoptando sistemas multinivel. Este artículo ha hecho referencia al Reglamento de IA de la UE recientemente aprobado, que representa un gran paso adelante para evitar esta amenaza, además de constituir un punto de partida que podría inspirar a otros países u organizaciones internacionales, al basarse en los valores esenciales de la UE, tales como la protección de la salud, la seguridad y los derechos fundamentales, así como la democracia, el Estado de derecho, la protección del medio ambiente, entre otros. La coordinación, negociación y acuerdo entre países y organizaciones internacionales será fundamental si se pretende democratizar la IA.

En este contexto, el modelo empresarial de la economía social representa una oportunidad para luchar contra las amenazas que comporta el desarrollo de la IA. Al situar la persona, y no el capital, en el centro de la actividad empresarial, la defensa y preservación del puesto de trabajo de cada socio trabajador adquiere una relevancia primordial, y se consigue así un reparto más equitativo de la riqueza que se genere. En consecuencia, los beneficios que se pudieran obtener gracias a la IA quedarían más equitativamente repartidos y, por ende, se colaboraría en la reducción de la desigualdad a escala global. Si tenemos en cuenta que la economía social se encuentra presente en los diferentes sectores económicos, no existe razón alguna para pensar que no pueda estarlo también en el desarrollo de la IA, a través de empresas que sitúen en un primer plano valores fundamentales como la gestión y participación democrática, la autonomía e independencia, así como el interés por la comunidad.

Anexo en la versión pdf

Referencias bibliográficas

Aguirre Sala, Jorge Francisco. «Los desafíos de la transformación digital de la democracia». RECERCA. Revista de Pensament i Anàlisi, vol. 26, n.º 2 (2021). DOI: https://doi.org/10.6035/recerca.4660 (en línea).

Alfonso Rojas, Juan Ricardo; Díaz, Sthefany Loriet y Ramírez Montúfar, Álvaro Hernando. «Efecto de la monetización de datos personales, provenientes de plataformas digitales, sobre el derecho a la privacidad». Lex, Revista de Investigación en Ciencias Jurídicas, vol. 6, n.º 22 (2023) (en línea) http://repositorio.cidecuador.org/jspui/handle/123456789/2859

Alianza Cooperativa Internacional. «Jeremy Rifkin: Los modelos cooperativos podrían liderar la revolución digital», (27 de octubre de 2016) (en línea) https://ica.coop/es/sala-de-prensa/noticias/jeremy-rifkin-modelos-cooperativos-podrian-liderar-revolucion-digital

Baack, Stefan (2015). «Datafication and empowerment: How the open data movement re-articulates notions of democracy, participation, and journalism». Big Data & Society, vol. 2, n.º 2 (2015), 2. DOI: https://doi.org/10.1177/2053951715594634

Barranco, Justo. «Yuval Noah Harari “Los algoritmos ya han matado a gente”». La Vanguardia, (3 de septiembre de 2024) (en línea) https://www.lavanguardia.com/cultura/20240903/9907895/yuval-noah-harari-nexus-sapiens-inteligencia-artificial-trump-israel-palestina.html

Cairó Céspedes, Gemma. «Reseña: Cédric Durand; Tecnofeudalismo. Crítica a la economía digital (2021)». Revista de Economía Crítica, n.º 33 (2022), p. 102-104.

Chávez Ávila, Rafael y Monzon Campos, José Luis. «La economía social ante los paradigmas económicos emergentes: innovación social, economía colaborativa, economía circular, responsabilidad social empresarial, economía del bien común, empresa social y economía solidaria». CIRIEC-España, Revista de Economía Pública, Social y Cooperativa, n.º 93 (2018), p. 5-50. DOI: 10.7203/CIRIEC-E.93.12901

Coll, Maria. «Antonio Luis Terrones: “Estem davant d'un blanquejament ètic de la IA”». Revista Valors, (2 de marzo de 2024) (en línea) https://valors.org/estem-davant-dun-blanquejament-etic-de-la-ia/

Co-operative News. «Joseph Stiglitz proposes co-op models as an alternative to trickle-down economics». Coop News, (12 de octubre de 2016) (en línea) https://www.thenews.coop/110090/sector/community/joseph-stiglitz-proposes-co-ops-models-alternative-trickle-economics/

Corbett-Davies, Sam; Pierson, Emma; Feller, Avi; Goel, Sharad y Huq, Aziz. «Algorithmic decision making and the cost of fairness». ArXiv, (2017), p. 797-806 (en línea) https://arxiv.org/abs/1701.08230

Cruz Fuentes, Daniel. «El sindicalismo es esencial para humanizar la inteligencia artificial». Revista Perspectiva, (11 de abril de 2023) (en línea) https://perspectiva.fsc.ccoo.es/noticia:660887--El_sindicalismo_es_esencial_para_humanizar_la_inteligencia_artificial

Durand, Cédric. «Tecnofeudalismo: la nueva gleba digital». Viento Sur, n.º 173, (29 de enero de 2021a) (en línea) https://vientosur.info/tecnofeudalismo-la-nueva-gleba-digital/

Durand, Cédric. Tecnofeudalismo. Crítica a la economía digital. Donostia: Kaxilda, 2021b.

Europa Press. «Meta más que duplica sus beneficios en el primer trimestre y eleva previsiones de gasto por la IA», (25 de abril de 2024) (en línea) https://www.europapress.es/economia/noticia-meta-mas-duplica-beneficios-primer-trimestre-eleva-previsiones-gasto-ia-20240425133550.html

Gibert, Karina. «L'ètica de la IA: més enllà de la regulació». Revista Valors, (13 de marzo de 2024) (en línea) https://valors.org/letica-de-la-ia-mes-enlla-de-la-regulacio/

Gries, Thomas y Naudé, Wim. «Artificial Intelligence, Jobs, Inequality and Productivity: Does Aggregate Demand Matter». IZA Discussion Paper Series, n.º 12005 (noviembre de 2018) (en línea) https://www.iza.org/publications/dp/12005/artificial-intelligence-jobs-inequality-and-productivity-does-aggregate-demand-matter

Gulson, Kalervo N. y Sellar, Sam. «Emerging data infrastructures and the new topologies of education policy». Environment and Planning D: Society and Space, vol. 37, no.º 2 (2019), p. 350-366. DOI: https://doi.org/10.1177/0263775818813144

Gutiérrez Almazor, Miren. «Algorithmic Gender Bias and Audiovisual Data: A Research Agenda». International Journal of Communication, n.º 15 (2021), p. 439-461.

Harari, Yuval Noah. Nexus: Una breve historia de las redes de información desde la Edad de Piedra hasta la IA. Barcelona: Debate, 2024.

Helbing, Dirk; Frey, Bruno S.; Gigerenzer, Gerd; Hafen, Ernst; Hagnet, Michael; Hofstetter, Yvonne; Van den Hoven, Jeroen; Zicari, Roberto V. y Zwitter, Andrej. «Will Democracy Survive Big Data and Artificial Intelligence?». Scientific American, (25 de febrero de 2017) (en línea) https://www.scientificamerican.com/article/will-democracy-survive-big-data-and-artificial-intelligence/

Innerarity, Daniel. «El impacto de la inteligencia artificial en la democracia». Revista de las Cortes Generales, n.º 109 (2020), p. 87-103. DOI: https://doi.org/10.33426/rcg/2020/109/1438

Innerarity, Daniel. «The Data-Driven Pandemic: A new conceptualization of the Data Society». STG Resilience Papers, School of Transnational Governance (2021).

Innerarity, Daniel. «Inteligencia artificial y democracia», en: Lazzarini, Carlos G. (dir.) Inteligencia artificial y política. Los desafíos de una tecnología acelerada en las instituciones contemporáneas. Buenos Aires: IcaP, 2022, p. 25-37.

Innerarity, Daniel. «Justicia algorítmica y autodeterminación deliberativa». ISEGORÍA, Revista de Filosofía moral y política, n.º 68 (2023a), e23. DOI: https://doi.org/10.3989/isegoria.2023.68.23

Innerarity, Daniel. «Predient el passat: una crítica filosòfica de l’anàlisi predictiva». IDP, Revista de Internet, Derecho y Política, n.º 39 (2023b), p. 1-11. DOI: https://doi.org/10.7238/idp.v0i39.409672

Innerarity, Daniel. «The epistemic impossibility of an artificial intelligence take-over of democracy». AI & Society, vol. 39, (2023c), p. 1.667-1.671. DOI: https://doi.org/10.1007/s00146-023-01632-1

Korinek, Anton y Stiglitz, Joseph E. «Artificial Intelligence and Its Implications for Income Distribution and Unemployment», en: Agrawal, Ajay; Gans, Joshua y Goldfarb, Avi (eds.) The Economics of Artificial Intelligence: An Agenda. Chicago: University of Chicago Press, 2019, p. 349-390.

Lobato Rodríguez, Marta M. «Reseña de “El Capital en el Siglo XXI”, de Thomas Piketty». Perifèria, Revista de Recerca i Formació en Antropologia, vol. 19, n.º 2 (2014), p. 144-156.

Maldita. «Qué datos personales puedes impedir que Facebook e IG utilicen para entrenar su inteligencia artificial (y cuáles no) y cómo hacerlo». Maldita.es, (6 de septiembre de 2023) (en línea) https://maldita.es/malditatecnologia/20230906/datos-personales-meta-entrenar-IA/

Masut, Federica y Schmidt, Johanna (2024).« Inteligencia artificial, Responsabilidad humana. Documento de posición de Triodos Bank sobre la IA ética». Triodos Bank. https://www.triodos.es/binaries/content/assets/tbes/vision-papers/24158_triodos_documento_vision_ia.pdf

Mejías, Ulises A. y Couldry, Nick. «Datificación». Revista Latinoamericana de Economía y Sociedad Digital, (2022) (en línea). DOI: https://doi.org/10.53857/hced6196

Monreal Garrido, Manuel. «Inteligencia Artificial. Implicaciones y aplicaciones en la Economía Social», en: Chaves Ávila, Rafael y Vañó Vañó, María José. Dos decenios de actividad universitaria en economía social, cooperativismo y emprendimiento desde el instituto universitario IUDESCOOP. Instituto Universitario de Economía Social, Cooperativismo y Emprendimiento (IUDESCOOP), CIRIEC-España, Revista de Economía Pública, Social y Cooperativa (2023). DOI: https://doi.org/10.7203/10550/90499

Morozov, Evgeny. Capitalismo Big Tech. ¿Welfare o neofeudalismo digital? Madrid: Enclave de Libros, 2018.

Moscardó Benavent, Susana. «Reseña de “La era del capitalismo de la vigilancia. La lucha de un futuro humano frente a las nuevas fronteras del poder”, de Shoshana Zuboff». SCIO. Revista de Filosofía, n.º 20 (2021), p. 265-269.

Murrugarra Retamozo, Brenda Isabel. «Inteligencia artificial y privacidad en internet: amenazas para los datos personales de los usuarios». Revista Científica Multidisciplinaria Ogma, vol. 3, n.º 2 (2024), p. 30-48. DOI: https://doi.org/10.69516/9dp8ap45

Naciones Unidas. «Los riesgos de la inteligencia artificial para la privacidad exigen medidas urgentes –Bachelet», Comunicado de prensa, (15 de septiembre de 2021) (en línea) https://www.ohchr.org/es/press-releases/2021/09/artificial-intelligence-risks-privacy-demand-urgent-action-bachelet

Nikunen, Kaarina y Hokka, Jenni. «Welfare State Values and Public Service Media in the Era of Datafication». Global Perspectives, vol. 1, n.º 1 (2019) (en línea). DOI: https://doi.org/10.1525/gp.2020.12906

Parlamento Europeo. «Artificial intelligence: threats and opportunities», (23 de septiembre de 2020) (en línea) https://www.europarl.europa.eu/topics/en/article/20200918STO87404/artificial-intelligence-threats-and-opportunities

Pastor Sempere, Carmen. «La nueva Economía Social del Dato (ESD)». CIRIEC-España, Revista Jurídica de Economía Social y Cooperativa, n.º 41 (2022), p. 13-44. DOI: https://doi.org/10.7203/CIRIEC-JUR.41.25571

Piketty, Thomas. El Capital en el siglo XXI. Madrid: FCE, 2014.

Poell, Thomas; Nieborg, David B. y Van Dijck, José. «Platformisation». Concepts of the Digital Society, vol. 8, n.º 4 (2019) (en línea). DOI: https://doi.org/10.14763/2019.4.1425

Prabhakaran, Vinodkumar; Mitchell, Margaret; Gebru, Timnit y Gabriel, Iason. «A Human Rights-Based Approach to Responsible AI». ArXiv, (2022), p. 1-17 (en línea) https://arxiv.org/abs/2210.02667

Rhea, Alene; Markey, Kelsey; D'Arinzo, Lauren; Schellman, Hilke; Sloane, Mona; Squires, Paul y Stoyanovich, Julia. «Resume Format, LinkedIn URLs and Other Unexpected Influences on AI Personality Prediction in Hiring: Results of an Audit», en: VVAA, Proceedings of the 2022 AAAI/ACM Conference on AI, Ethics, and Society, (2022), p. 572-587. DOI: https://doi.org/10.1145/3514094.3534189

Sachs, Jeffrey D. The Ages of Globalization: Geography, Technology and Institutions. Nueva York: Columbia University Press, 2020.

Salicrú Maltas, Joan. «Núria Oliver: Necessitem la IA per afrontar els grans reptes del segle XXI». Revista Valors, (7 de marzo de 2024) (en línea) https://valors.org/necessitem-la-ia-per-afrontar-els-grans-reptes-del-segle-xxi/

Samoli, Sofia; López Cobo, Montserrat; Gómez Gutiérrez, Emilia; De Prato, Giuditta; Martínez-Plumed, Fernando y Delipetrev, Blagoj. AI Watch. Defining Artificial Intelligence. Towards an operational definition and taxonomy of artificial intelligence. Luxembourg; Publications Office of the European Union, 2020 (en línea) https://publications.jrc.ec.europa.eu/repository/handle/JRC118163

Sassen, Saskia. Expulsions. Brutality and Complexity in the Global Economy. Cambridge, MA: Harvard University Press, 2014.

Serrano Robles, Eloi. «Introducció a l'economia social», en: Serrano, Eloi (coord.) Introducció a l'economia i l'empresa social. Barcelona: Icaria, 2019

Serrano Robles, Eloi. La contribución de la economía social a la sostenibilidad (una revisión metodológica para el análisis económico). Tesis doctoral, Universitat de les Illes Balears, 2024.

Sharpa Marketing. «14 Herramientas de Inteligencia Artificial para Linkedin». Sharpa, (2017) (en línea) https://www.sharpamarketing.com/es/blog/14-herramientas-de-inteligencia-artificial-para-linkedin/

Starke, Christopher; Baleis, Janine; Keller, Birte y Marcinkowaki, Frank. «Fairness perceptions of algorithmic decision-making: A systematic review of the empirical literature». Big Data & Society, vol. 9, n.º 2 (2022), p. 1-16. DOI: https://doi.org/10.1177/20539517221115189

Tolan, Songül. «Fair and Unbiased Algorithmic Decision Making: Current State and Future Challenges». Digital Economy Working Paper [Background paper to the European Commission’s report: ‘Artificial Intelligence: A European Perspective’]. European Commission - Joint Research Centre (2019). https://arxiv.org/abs/1901.04730

Toro, Oriol. «Núria Vallès: “Tot algoritme està vinculat a un sistema de valors”». Revista Valors, (1 de marzo de 2024) (en línea) https://valors.org/tot-algoritme-esta-vinculat-a-un-sistema-de-valors/

Unión Europea. «Reglamento (UE) 2024/1689 del Parlamento Europeo y del Consejo, de 13 de junio de 2024, por el que se establecen normas armonizadas en materia de inteligencia artificial y por el que se modifican los Reglamentos (CE) n.º 300/2008, (UE) n.º 167/2013, (UE) n.º 168/2013, (UE) 2018/858, (UE) 2018/1139 y (UE) 2019/2144 y las Directivas 2014/90/UE, (UE) 2016/797 y (UE) 2020/1828 (Reglamento de Inteligencia Artificial)». Diario Oficial de la Unión Europea, (12 de julio de 2024) (en línea) http://data.europa.eu/eli/reg/2024/1689/oj

Van Dijck, José. «Datafication, dataism and dataveillance: Big Data between scientific paradigm and ideology». Surveillance & Society, vol. 12, n.º 2 (2014), p. 197-208. DOI: https://doi.org/10.24908/ss.v12i2.4776

Varoufakis, Yanis. Technofeudalism. What Killed Capitalism. Londres: Vintage Books, 2023.

Zajko, Mike. «Artificial intelligence, algorithms, and social inequality: Sociological contributions to contemporary debates». Sociology Compass, vol. 16, n.º 3 (2022), e12962. DOI: https://doi.org/10.1111/soc4.12962

Zhao, Jieyu; Wang, Tianlu; Yatskar, Mark; Ordoñez, Vicente y Chang, Kai-Wei. «Men Also Like Shopping: Reducing Gender Bias Amplification using Corpus-level Constraints», en: Proceedings of the 2017 Conference on Empirical Methods in Natural Language Processing, (2017), p. 2.979-2.989. DOI: https://doi.org/10.18653/v1/D17-1323

Zia, Tehseen. «Democratización de la IA: cómo impulsa a las personas y a las industrias [entrada de blog]». Techopedia., (29 de diciembre de 2023) (en línea) https://www.techopedia.com/es/democratizacion-ia

Zuboff, Shoshana. La era del capitalismo de la vigilancia. La lucha por un futuro humano frente a las nuevas fronteras del poder. Barcelona: Paidós, 2020.

Palabras clave: economía social, cooperativismo, inteligencia artificial (IA), democratización, equidad, desigualdad

Cómo citar este artículo: Guillén Burguillos, Miguel y Serrano Robles, Eloi. «Oportunidades desde la economía social en la lucha contra las amenazas de la IA». Revista CIDOB d’Afers Internacionals, n.º 138 (diciembre de 2024), p. 145-170. DOI: doi.org/10.24241/rcai.2024.138.3.145

Revista CIDOB d’Afers Internacionals, nº 138, pp. 145-170

Cuatrimestral (septiembre-diciembre 2024)

ISSN:1133-6595 | E-ISSN:2013-035X

DOI: https://doi.org/10.24241/rcai.2024.138.3.145

Fecha de recepción: 19.03.24 ; Fecha de aceptación: 18.09.24